915 752 750

915 752 750

aec@aec.es

aec@aec.es

915 752 750

915 752 750

aec@aec.es

aec@aec.es

Una vez que tenemos claro a dónde van los datos personales de nuestra responsabilidad, y que son adecuados, pertinentes y limitados a lo necesario en relación con los fines para los que se van a tratar, el segundo paso que tenemos que seguir es la determinación del instrumento en el que vamos a basar la transferencia (Capítulo V RGPD).

Los instrumentos que tenemos a nuestra disposición son los siguientes:

1. Decisiones de adecuación de la Comisión Europea (art. 45 RGPD).

2. Instrumentos de transferencia que ofrecen garantías adecuadas (art. 46 RGPD).

3. Vía de excepción (art. 49 RGPD).

La vía de excepción del artículo 49 permite la transferencia internacional siempre y cuando no dispongamos de una decisión de adecuación de la Comisión Europea, ni podamos hacer la transferencia conforme a algún instrumento que ofrezca las garantías adecuadas. Es decir, a la hora de elegir el instrumento adecuado hemos de comprobar primero si existe una decisión de adecuación; después, si podemos realizarla conforme a cualquier instrumento de transferencia con garantías adecuadas, y solo en ausencia de las dos primeras opciones, acudir a la vía de excepción.

Como cierre, si tampoco fuera aplicable ninguna de las excepciones que ofrece el artículo 49 RGPD, solo podremos llevar a cabo la transferencia internacional si no es repetitiva, afecta solo a un número limitado de interesados, es necesaria a los fines de intereses legítimos imperiosos que persigamos y sobre los que no prevalezcan los intereses o derechos y libertades del interesado, y hayamos evaluado todas las circunstancias concurrentes en la transferencia de datos. Basándonos en esta evaluación, habremos de ofrecer garantías apropiadas con respecto a la protección de datos personales, y en este caso, habremos de informar a la autoridad de control de la transferencia.

1. Decisiones de adecuación.

La Comisión Europea ha reconocido que ciertos países ofrecen un nivel adecuado de protección de los datos personales. Si la empresa importadora se encuentra en alguno de estos países, no tendremos que adoptar ninguna otra medida adicional.

2. Instrumentos de transferencia con garantías adecuadas.

Los instrumentos numerados en el artículo 46 (cláusulas tipo, normas corporativas vinculantes, códigos de conducta, mecanismos de certificación y cláusulas contractuales específicas) contienen garantías adecuadas y pueden ser utilizados en ausencia de decisión de la Comisión Europea. El instrumento tiene que garantizar que los datos personales transferidos gocen de un nivel de protección esencialmente equivalente, pero hemos de tener en cuenta que es posible que la situación del tercer país al que exportamos los datos personales puede requerir que tomemos medidas complementarias para garantizar ese nivel de protección.

3. Evaluación de la eficacia del instrumento de transferencia.

Es posible que en el país de destino de la transferencia existan legislación o prácticas en vigor que socaven la eficacia de las garantías adecuadas de los instrumentos de transferencia del artículo 46 RGPD. La protección ofrecida ha de ser esencialmente equivalente a la garantizada en el Espacio Económico Europeo, y habremos de comprobar este extremo con la ayuda del importador de los datos personales, y siempre sobre las circunstancias específicas de la transferencia de datos que pretendemos llevar a cabo, nunca de modo general. Es recomendable acordar con el importador los extremos de esta colaboración y fijarlos en un documento de trabajo conjunto, ya que habrá que revisar la evaluación si se producen cambios que puedan afectar a las circunstancias de la transferencia.

Además de las circunstancias específicas de los datos que se quieren transferir (tipo de datos, finalidad, formato de transferencia, entidades participantes, etc.), es muy importante incluir a todos los agentes que puedan participar, sobre todo si van a existir transferencias ulteriores. Habremos de exigir información fiable al importador sobre estas transferencias, así como documentar todas sus características e incluirlas en nuestra evaluación de idoneidad.

Tendremos que comprobar si la legislación vigente y las prácticas en el país respeta los derechos fundamentales de los titulares de los datos personales. Es posible que se concedan poderes a las autoridades públicas que los restrinjan, pero habrá de tratarse de medidas necesarias y proporcionadas en una sociedad democrática, al igual que ocurre en los Estados miembros de la Unión Europea. Se considera que son incompatibles si no respetan la esencia de los derechos y libertades fundamentales de la Carta de los Derechos Fundamentales de la Unión Europea, o si exceden lo dispuesto en las salvaguardas contempladas en el artículo 23 RGPD. Para esto, acudiremos a las Recomendaciones 02/2020 del Comité Europeo de Protección de Datos sobre las garantías esenciales europeas para medidas de vigilancia, de 10 de noviembre de 2020, para conocer qué se entiende como injerencia justificable.

Como resultado final de esta evaluación, es posible que encontremos que la legislación presente problemas de compatibilidad, que no garantice el nivel esencialmente equivalente de protección y que la transferencia de datos personales o la actividad del importador caiga bajo el ámbito de aplicación de esta legislación. En este caso, tendremos tres opciones:

1. No realizar la transferencia o suspenderla, si es que se estaba llevando a cabo.

2. Aplicar medidas complementarias para lograr el nivel de protección.

3. No aplicar medidas complementarias si no hay motivos para creer que esta legislación se aplique al caso concreto.

Como siempre, habremos de documentar exquisitamente este análisis para cumplir con el principio de responsabilidad proactiva.

Félix Haro

Govertis, parte de Telefónica Tech

El pasado 11 de junio tuvo lugar el II Insight del Club del DPD de 2024 organizado por la Asociación Española para la Calidad, con la colaboración de Govertis, parte de Telefónica Tech.

El evento fue dirigido por Javier Villegas, Lead Advisor y responsable de Desarrollo de Negocio del territorio sur de Govertis y se dividió en tres partes: la ponencia sobre «Privacidad y Marketing digital, ¿cómo nos preparamos para un mundo sin cookies?»; la mesa redonda sobre «El papel del DPD en los medios de comunicación. ¿Una profesión de riesgo?» y, un taller práctico sobre el desarrollo de proyectos de investigación y protección de datos.

La primera ponencia fue impartida por Lorena Roque Masi, responsable de Ads Privacy en Google España, en la que se trató de abordar la influencia de las cookies en la vida cotidiana de las personas y en el marketing digital.

«Nos movemos de un mundo donde medíamos el 1:1 a un mundo consentido, agregado y anonimizado. Tenemos que aprender a hacer más con menos» – explicó Roque destacando que los cambios regulatorios y tecnológicos para proteger la privacidad de los usuarios en internet están transformando radicalmente la industria de la publicidad online.

En un segundo bloque, se dio paso a una mesa redonda moderada por Santiago Cruz Roldán, DPD externo en Tele Madrid y miembro de Govertis Telefónica Tech, en la que participaron Luis Javier Sánchez, periodista especializado en Derecho TIC y Jesús Fernández Acevedo, abogado y DPD, la cual versó sobre la problemática del tratamiento de los datos personales en los medios de comunicación. En concreto, durante las ponencias se abordaron las siguientes cuestiones:

1. La ponderación entre el derecho a la libertad de información y el derecho a la protección de datos en situaciones de inmediatez.

Luis Javier Sánchez indicó que esta cuestión es una problemática que se lleva arrastrando desde hace mucho tiempo y para la que no existe una solución concreta. Los medios de comunicación han ido aprendiendo lo que se puede o no se puede publicar a raíz, por ejemplo, de sanciones impuestas por la Agencia Española de Protección de Datos (AEPD).

Actualmente, se tiene un especial cuidado con temas relacionados con menores o anonimización de sentencias jurisprudenciales, sin embargo, sigue siendo un ámbito escasamente regulado.

2. La necesidad de establecer unas directrices que regulen la protección de datos en los medios de comunicación.

Jesús Fernández puso de relieve la necesidad de concienciar a los periodistas sobre la normativa de protección de datos y cómo esta puede afectar a la calidad de las noticias. En este sentido, Jesús defendió la importancia de contar con un protocolo que regule esta materia como ocurrió con el documento de «buenas prácticas en materia de comunicación» elaboradas por la Autoridad Italiana de Protección de Datos que contiene una serie de recomendaciones sobre cómo se puede tratar la información de una forma ética y respetuosa.

Ambos ponentes apuntaron la pérdida de oportunidad del Legislador español de regular esta materia a raíz de la entrada en vigor del actual Reglamento General de Protección de Datos (RGPD).

3. La importancia de la figura del DPD en los medios de comunicación.

Respecto a este tema, Jesús Fernández quiso resaltar que la figura del DPD en los medios de comunicación no está suficientemente valorada, en numerosas ocasiones, debido a la inmediatez que requieren determinadas noticias.

Por ello, según Fernández, es fundamental formar a los trabajadores de los medios de que existe la figura y las funciones del DPD para que puedan acudir a ellos en los casos de duda.

A raíz de lo expuesto durante la jornada, Luis Javier Sánchez abogó por la creación de un Pacto Digital entre los medios de comunicación y la Agencia Española de Protección de Datos.

4. ¿La actuación del DPD en determinadas ocasiones es vista por los periodistas como una injerencia?

En este sentido, Luis Javier Sánchez apuntó que los periodistas, en un primer momento, sí que pueden ver la actuación del DPD como un obstáculo debido a la inmediatez con la que se publican las noticias. Explicó que sería obligatorio un diálogo interno en los medios donde se exponga la necesidad de ser cauteloso en determinadas ocasiones por las posibles consecuencias que pueden surgir posteriormente como, por ejemplo, multas de la AEPD.

Asimismo, según Jesús Fernández, cada vez hay más periodistas concienciados con dar cumplimiento a la normativa de protección de datos.

5. ¿Qué protocolos se puede implementar para dar cumplimiento a la normativa de protección de datos?

Fernández sostuvo que es necesario realizar una evaluación de los contenidos que puedan generar más riesgo (grabaciones de menores durante las cabalgatas del día de Reyes, a las puertas de juzgados y tribunales o de los cofrades durante las procesiones de Semana Santa) y tener un mapa de actuación.

La conclusión general de la ponencia se tradujo en la creación de un protocolo donde se recojan los aspectos clave que deben tener en cuenta los medios de comunicación para dar cumplimiento a la normativa de protección de datos.

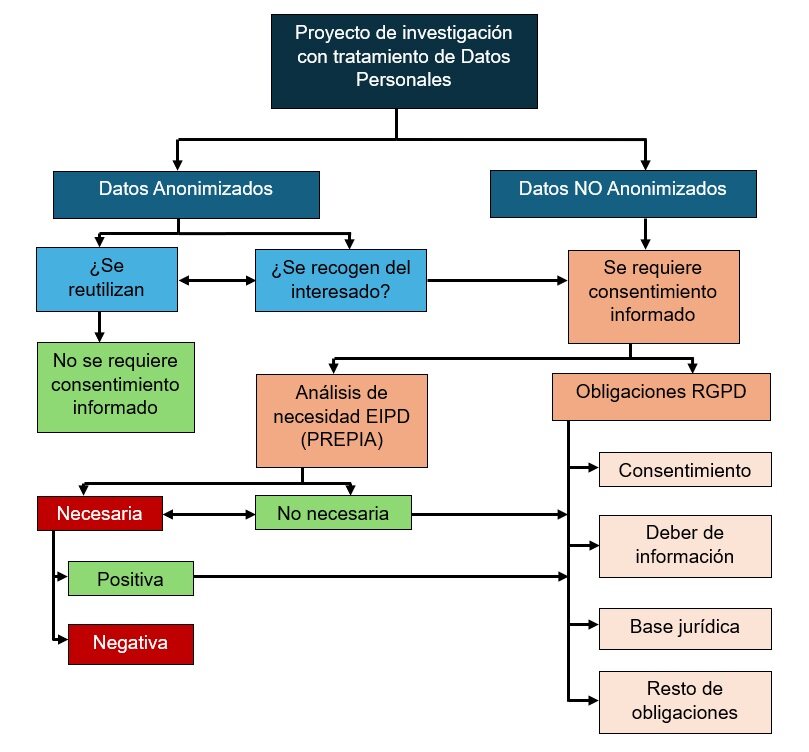

Para finalizar el encuentro, se dio paso a Borja Sendra Buigues, DPD y miembro de Govertis, parte de Telefónica Tech, que impartió un taller práctico orientado a cómo aplicar la normativa sobre protección de datos en los comités de ética universitarios en proyectos de investigación.

Durante la ponencia, se explicó que el papel del DPD en el Comité de ética y evaluación es dar soporte a los investigadores (redacción de cláusulas informativas, realizar una Evaluación de Impacto de la Protección de Datos -EIPD- o instruir sobre el buen uso de la información) y, velar por el cumplimiento de la normativa.

En concreto, los proyectos de investigación es preciso que cumplan el principio de privacidad desde el diseño y por defecto, diseñando el tratamiento en la memoria del proyecto e imponiendo las medidas necesarias para proteger los datos, que se aplicarán durante todo el proceso y cuando este finalice.

El Comité es responsable de analizar toda la información del proyecto (tipología de datos, origen, finalidad, destinatarios, información facilitada a los interesados, etc.) para comprobar si el tratamiento es conforme al RGPD.

En resumen, los pasos que tiene que seguir el Comité para analizar si un proyecto de investigación cumple con las obligaciones recogidas en el RGPD son los siguientes:

II Insight del Club del DPD – 2024

Claudia Arias

Govertis, parte de Telefónica Tech

KEEP READINGLa protección del menor en Internet, desde la perspectiva del derecho fundamental a la protección de datos de carácter personal, ha estado presente en la legislación española (artículo 13 del RDLOPD) y así continúa considerándose (artículo 7 y artículo 84 LOPDGDD); estando, de este modo, en sintonía con el sentir del legislador europeo (artículo 8 RGPD).

Actualmente, es cada vez mayor la preocupación por resguardar a los menores de contenidos para adultos, que puedan perjudicar a su desarrollo físico, mental o moral. Es por esto que, la Agencia Española de Protección de Datos (AEPD), a los efectos de restringir el acceso a este tipo de contenidos, presentó un sistema de verificación de edad para proteger a los menores de edad. Este sistema de verificación no busca que los proveedores de Internet puedan conocer la edad exacta del usuario, o incluso su identidad, o someterlo a vigilancia y seguimiento, sino que se trata de un primer paso que avanza en el interés común de proteger a los menores del acceso incontrolado a contenidos inadecuados.

Los sistemas y soluciones actuales de verificación de edad -véase, por ejemplo, cualquiera de los modelos de autodeclaración de mayoría de edad, habilitadores de acceso sin restricciones a contenidos para adultos- presentan grandes deficiencias, no siendo conformes, en absoluto, a las citadas disposiciones de la normativa en protección de datos personales.

Este tipo de acceso incontrolado a dichos contenido supone, en la mayoría de las ocasiones, una infracción de los principios generales en protección de datos y, por ende, deben considerarse de carácter muy grave. Entre otros, se efectúa una recogida de datos personales innecesario (incluso, perfilado de usuarios, con observación de hábitos de navegación y localización) con una total falta de transparencia y sin estar legitimados, obviamente, por los titulares de la patria potestad o tutela.

Esto, por supuesto, supone un alto riesgo para los derechos y libertades fundamentales de los menores. En aras a proteger el interés superior de los menores, la AEPD ha publicado un Decálogo de Principios. Este decálogo se configura como exigencias mínimas que deben cumplir los sistemas de verificación de edad y del que se desprenden las siguientes ideas:

• No se persigue que el proveedor conozca que la persona que accede a Internet es menor, sino que tengan la garantía de que la persona puede hacerlo, acreditando su condición de “persona autorizada a acceder”.

• El sistema debe garantizar que no es posible la identificación, el seguimiento o la localización de menores a través de Internet.

• El sistema debe garantizar que las personas no pueden ser perfiladas en función de su navegación.

• Todo sistema debe tener definido un marco de gobernanza.

• La estrategia más adecuada para la gestión del sistema es aquella que vela por preservar el anonimato del usuario, debido al alto riesgo de estos sistemas.

• Para el diseño y la implementación del sistema, se tomará como base el interés superior del menor y el derecho a la privacidad y la intimidad.

• Los sistemas, en la medida que supongan un tratamiento de datos personales, han de estar legitimados, ser idóneos, necesarios y proporcionales.

• Se obliga a implementar todas las medidas de privacidad necesarias que resulten de la realización de una evaluación de impacto para la protección de datos y superar un análisis de idoneidad, necesidad y proporcionalidad.

A partir de este Decálogo, la AEPD, con la colaboración de un equipo del Consejo General de Colegios Profesionales de Ingeniería Informática, realizó una serie de pruebas para demostrar que la protección del menor se puede materializar de forma práctica y concreta. Así, estas pruebas se han desarrollado sobre distintos tipos de sistemas y empleando varios proveedores de identidad accesibles a la ciudadanía, demostrando la viabilidad de su aplicación y diversas formas prácticas de llevarlo a escenarios reales.

No obstante, la AEPD nos aclara que este sistema de verificación de edad no pretenden ser una solución final única (con esto, preserva la neutralidad tecnológica y el libre mercado de opciones) sino demostrar que es posible la puesta en marcha de un sistema efectivo y animar, así, a los distintos intervinientes en el ecosistema de Internet a encontrar sus propias soluciones respetuosas con los derechos fundamentales. En esta línea, la Fábrica Nacional de Moneda y Timbre (FNMT) se ha comprometido a desarrollar una app, que servirá para ayudar a proteger a este colectivo tan vulnerable.

En fin, desde aquí queremos continuar haciendo eco de esta iniciativa de nuestra autoridad de control española e instar a que los distintos proveedores de contenido e intervinientes de Internet, (en particular, páginas de pornografía, sitios de juego, redes sociales con contenidos de todo tipo, páginas de venta de tabaco o alcohol, etc.) adopten sistemas de verificación de la edad de sus usuarios, con arreglo al citado Decálogo, y cumplir con los requisitos necesarios para proteger los datos personales de todos éstos, adultos y menores, a la vez que se protege el interés superior de estos últimos.

Eva Mª Simón, CdC Privacidad de Govertis part of Telefonica Tech.

KEEP READING

El pasado mes de diciembre tuvo lugar en Madrid el VI Congreso de Privacidad «Diálogos de DPDs» organizado por la Asociación Española para la Calidad, con la colaboración de GOVERTIS, parte de Telefónica Tech.

En la ponencia inaugural, Ofelia Tejerino, presidenta de la Asociación de Internautas, destacó la necesidad de abordar la ciberseguridad de manera integral, mediante el establecimiento de estándares técnicos, legales y éticos en los procesos que implementen sistemas de IA para mitigar riesgos inherentes. Además, subrayó la importancia de asumir una responsabilidad proactiva, así como la necesidad de inversión en I+D en talento y formación, generando así un impacto positivo en el capital reputacional de las empresas.

La primera mesa redonda, moderada por María Loza, responsable del Centro de Competencia de Tecnologías Emergentes de Govertis, en la que participaron Antonio Muñoz, Director de la oficina global del DPD de Telefónica; Estrella Gutiérrez, Profesora en la Universidad Complutense y Doctora en Derecho; Santiago Ferrís, Jefe del Servicio de Telecomunicaciones de la Generalitat Valenciana y Manuel González, Jefe del Gabinete de Cumplimiento, Consejo de Transparencia y Protección de Datos de Andalucía, versó sobre los retos ante la propuesta de regulación de la IA en el nuevo Reglamento Europeo. Las ponencias abordaron las siguientes cuestiones:

1. La propuesta de reglamento de IA no es la primera, ni la única norma.

Antonio Muñoz indicó que existe un cierto consenso en los principios, riesgos y la forma de mitigarlos, a pesar de que las aproximaciones sean diferentes. También describió diferentes modelos normativos que existen a nivel mundial (Brasil, China, EE.UU.) y sus principales rasgos, pero, sobre todo, destacó la importancia de generar preocupación y, a partir de ahí, convergencia en las soluciones.

2. Concepto de IA. Explicabilidad y Transparencia. Desafíos en la implementación de sistemas prohibidos en el ámbito del Sector Público.

Es importante delimitar el concepto de IA y, de hecho, la definición se ha ido modificando en las diferentes versiones de la propuesta de Reglamento, incluyendo, por ejemplo, sistemas estadísticos.

Estrella Gutiérrez destacaba que Interpretabilidad, transparencia y explicabilidad son términos diferentes, interrelacionados, pero distintos.

Actualmente, las licitaciones pocas veces incluyen requisitos de transparencia o métricas de error y se han licitado sistemas de IA definidos como sistemas prohibidos.

Surge la cuestión de cómo se determina el impacto o cuáles son los criterios para determinar dicho impacto, en la seguridad, derechos fundamentales y la salud.

Para la Administración Pública será un desafío ya que, como apuntaba Santiago Ferrís, deberán realizarse evaluaciones de riesgo de todos los casos de uso aplicables a los procedimientos administrativos y servicios públicos, indicando con certeza, que se acabarán utilizando precisamente sistemas de IA.

Previamente, también deberán establecerse procedimientos mediante los que se decida y apruebe la implementación de un sistema de IA en la Administración Pública.

3. Cuestiones técnicas del Reglamento de IA

Santiago Ferrís enfatizó la necesidad de supervisión humana en sistemas de IA basados en correlaciones y también la dificultad de garantizar el anonimato. También aboga por un enfoque integral que aborde conjuntamente protección de datos e Inteligencia artificial y no diferentes sistemas de gobernanza.

Respecto a los riesgos técnicos, no hay un criterio único para todas las situaciones, por lo que debe analizarse cada caso.

En relación con la normalización, Santiago Ferrís entiende que es una solución a medio plazo y que deben desarrollarse estándares, métricas de error, etc. Manuel González puntualizó que serán organismos de naturaleza técnica, los que confeccionen los estándares técnicos normalizados que se deban implementar, lo cual tiene relevancia en lo que a derechos fundamentales se refiere.

4. Comparación entre el concepto de transparencia en el Reglamento de IA y el RGPD. Diferencias en las evaluaciones de impacto en protección de datos y derechos fundamentales.

Manuel González indicó que mientras que en el RGPD la transparencia, como se indica en el Considerando 39, radica en el conocimiento que el interesado tiene de qué, para qué y cuándo se tratan sus datos personales en la propuesta de reglamento de IA se habla de una definición explícita que apunta a que el usuario pueda comprender las capacidad, límites y riesgos y sea capaz de entender la información de salida.

La transparencia en la propuesta de reglamento de IA, aplica en tres niveles: sistemas de alto riesgo, sistemas de propósito general y a determinados sistemas de IA, frente al RGPD que aplica a todos los responsables de tratamiento en todos los casos.

Los sistemas de alto riesgo deberán cumplir con obligaciones de transparencia y registro de cierta información en bases de datos de acceso público, incluyendo el derecho a una explicación para las personas afectadas por decisiones automatizadas.

En lo relativo a la evaluación de impacto de derechos fundamentales que deberán realizar los usuarios, esta deberá coordinarse con la evaluación de protección de datos correspondiente.

5. Rol del DPD sobre la gobernanza de IA y coordinación con las diferentes autoridades de control en protección de datos y la Agencia Estatal de Inteligencia Artificial (AESIA).

Se coincidió por varios ponentes en que el rol del DPD es fundamental en el modelo de gobierno de la IA. El rol del DPD y todas las funciones de coordinación interna no deben replicarse, sino deben incorporar los mecanismos de aseguramiento de IA.

La AESIA y las autoridades de protección de datos deberán coordinarse, dada la interrelación de competencias, y deberán coordinarse, no solo con la AEPD, sino también con las autoridades de control autonómicas.

La segunda mesa redonda, moderada por Patrick Monreal, responsable del Centro de Privacidad de Govertis, contó con los expertos Pablo Garrote, abogado, profesor y DPD del Grupo IMQ; Eusebio Moya, Jefe de Protección de Datos y Seguridad de la Información de la Diputación de Valencia y DPD de la Institución y Francesc Xavier Urios, profesor y Jefe de la Asesoría Jurídica de la Autoridad Catalana de Protección de Datos. En ella se abordaron los nuevos frentes del DPD: AARR, EIPD en tecnologías disruptivas, destacando los problemas y riesgos de la contratación de proveedores relativos a las transferencias internacionales de datos, derivados de la falta de información y transparencia, así como la reticencia de los encargados de tratamiento de cara a la protección de los secretos industriales.

Por otro lado, se enfatizó en focalizar los esfuerzos de supervisar la tecnología que controla al dato, más que en el propio dato. También se recordó la importancia del consentimiento –que no lo puede todo-, que ha ser libre, aunque dicha condición no suele cumplirse cuando nos encontramos ante relaciones jerárquicas.

Otra cuestión fundamental que se destaca es el principio de atender al estado de la tecnología, debiendo implementarse medios para constatar la mayor fiabilidad de la misma, pero se resalta la preocupación de la posibilidad de habilitar paraísos tecnológicos, lo que conllevaría una gran inseguridad jurídica, al no haber, hasta la fecha, garantías para el control del fraude derivado de su uso.

Por último, David Rubio compartió su perspectiva sobre la situación actual de las transferencias internacionales de datos y el nuevo marco de privacidad de datos entre la UE y EE.UU., abordando cuestiones relativas al sistemático cuestionamiento ante el TJUE de los mecanismos establecidos en la UE para facilitar las exportaciones de datos personales de europeos, resultando cada vez más habitual que las jurisdicciones establezcan limitaciones a las exportaciones de datos personales desde sus territorios. Además, destaca la importancia del principio de responsabilidad proactiva en lo relativo a la necesidad de documentar todas las evaluaciones y decisiones relacionadas con las TID, manteniendo así una transparencia y trazabilidad constantes.

Cristina Zato. Equipo Govertis- Telefónica Tech.

KEEP READING

De manera sucinta, señalaremos los motivos por los que la figura del Delegado de Protección de Datos (DPD) tiene un papel ineludible y relevante en el modelo de organización y gestión del cumplimiento normativo del ámbito penal. Para ver este nexo de unión, partimos de ver quién es el DPD y qué contempla nuestro Código Penal. No abordaremos, en este breve artículo, la equiparación del modelo de organización y gestión del cumplimiento normativo del ámbito penal y de protección de datos personales; en cuanto a la responsabilidad proactiva o accountability.

Por un lado, el Delegado de Protección de Datos (DPD) es una figura, cuyo nombramiento y designación en una entidad, pública o privada, que efectúa actividades de tratamientos de datos de carácter personal, es obligatoria o, en su caso, de nombramiento y designación voluntaria, conforme al REGLAMENTO (UE) 2016/679 DEL PARLAMENTO EUROPEO Y DEL CONSEJO de 27 de abril de 2016 relativo a la protección de las personas físicas en lo que respecta al tratamiento de datos personales y a la libre circulación de estos datos y por el que se deroga la Directiva 95/46/CE (en adelante, RGPD) y la Ley Orgánica 3/2018, de 5 de diciembre, de Protección de Datos Personales y garantía de los derechos digitales (en adelante, LOPDGDD).

El DPD se ocupa, principalmente, de asesorar y supervisar el cumplimiento de la normativa en materia de protección de datos, por parte de la entidad, responsable o encargada del tratamiento de los datos personales.

De acuerdo con el artículo 39.2 RGPD “El delegado de protección de datos desempeñará sus funciones prestando la debida atención a los riesgos asociados a las operaciones de tratamiento, teniendo en cuenta la naturaleza, el alcance, el contexto y fines del tratamiento”.

Por otro lado, nuestro Código Penal contempla determinados delitos, como puede ser el delito de descubrimiento y revelación de secretos. Así, cuando los hechos descritos en los apartados anteriores afecten a datos de carácter personal que revelen la ideología, religión, creencias, salud, origen racial o vida sexual, o la víctima fuere un menor de edad o una persona con discapacidad necesitada de especial protección, se impondrán las penas previstas en su mitad superior (artículo 197.5 Código Penal).

Además, cabe decir que, el Código Penal, en el artículo 31.bis. 5, 1º y 4º, determina que, los elementos básicos del modelo de prevención de delitos, cuya responsabilidad penal pueda atribuirse a una persona jurídica, son, tanto la “identificación de las actividades en cuyo ámbito puedan ser cometidos los delitos que deben ser prevenidos” como “la obligación de informar de posibles riesgos e incumplimientos al organismo encargado de vigilar el funcionamiento y observancia del modelo de prevención.”

Es por esto que, en el modelo de organización y gestión del cumplimiento normativo del ámbito penal [que incluyen las medidas de vigilancia y control idóneas para prevenir delitos de la misma naturaleza o para reducir de forma significativa el riesgo de su comisión], la figura del Delegado de Protección de Datos debiera estar presente.

De este modo, analizando una parte de las funciones del DPD, se puede apreciar que:

• A fin de evitar la comisión de delitos, en el que el bien jurídico afectado fuera, por ejemplo, datos de categoría especial de la persona física, con el descubrimiento o revelación de secretos, la adopción medidas de seguridad, a nivel organizativo o técnico, conforme al artículo 32 del RGPD, es pertinente. Si no se aplica de forma adecuada la seguridad, además de la comisión de infracción de la normativa en protección de datos, puede dar lugar también a la comisión de delito; así a la persona jurídica, responsable del tratamiento de los datos personales o información, podría atribuirse responsabilidad penal.

• En todo caso, cabe recordar que, para que un hecho suponga responsabilidad penal de la persona jurídica, debe ser necesario que las medidas que han sido adoptadas estén directamente relacionadas o sean de la misma naturaleza que el delito que se trató de evitar; es decir, si la entidad, por ejemplo, no dispone de un control de accesos a la información para los distintos perfiles, no dispone de una política de seguridad o no puede evidenciarse que el personal tiene conocimiento de los controles implementados en la entidad, puede suponerse que no se han adoptado las medidas necesarias para minimizar el riesgo o “evitar” la comisión del delito. De modo que, la persona jurídica podría tener que responder de la comisión de aquellos hechos cometidos por el personal de su organización y que han supuesto una lesión del bien jurídico a proteger, en este caso, la intimidad de las personas físicas.

• Por otro lado, el DPD, dentro de un modelo de prevención de delitos, puede configurarse como una de las líneas de defensa dentro de la organización, pudiendo estar vinculado tanto con la 1ª como con la 2ª línea de defensa.

En este caso, el DPD debe contribuir a la adecuada implantación de aquellos controles que vengan directamente vinculados a la normativa de protección de datos, como la asignación de responsabilidades dentro de los departamentos de la entidad, la concienciación y formación del personal que participa en las operaciones de tratamiento de los datos, la adopción de las medidas de seguridad técnicas relacionadas con el artículo 32 del RGGPD y, por último, la realización de las correspondientes auditorías de aplicación de esos controles.

La aplicación de determinados controles puede contribuir a minimizar el riesgo de que pueda cometerse alguno de los tipos delictivos, que están directamente relacionados con la protección de datos y, por tanto, reducir la posibilidad de que la organización deba responder jurídicamente de los hechos derivados del incumplimiento de estos controles.

Ahora bien, en relación con esto, el DPD no debiera auditar las medidas de seguridad que él mismo hubiera indicado a la entidad responsable. De modo que, la auditoria debiera realizarse por persona externa; con esto, se acudiría a la llamada 4ª línea de defensa, la auditoría externa.

En definitiva, el papel del DPD, en el modelo de organización y gestión del cumplimiento normativo del ámbito penal, es pertinente, debiendo estar cuantas instrucciones emita, a la entidad responsable o encargada del tratamiento de los datos personales, contempladas en el el programa de cumplimiento normativo adoptar para la prevención de la comisión de delitos imputables a la persona jurídica.

Carolina Tella. GRC Consultant.

Equipo Govertis

Es posible que sí. Así se desprende del Informe Jurídico 2022/0098 de la Agencia Española de Protección de Datos (AEPD), en el que advierte de un posible cambio de criterio con respecto a la diferenciación de la finalidad de autenticación/verificación versus identificación de los tratamientos de datos biométricos en la que, hasta el momento, ha basado su interpretación de que solo en el segundo caso (identificación) nos encontramos ante tratamientos de categorías especiales de datos.

El Reglamento General de Protección de Datos (RGPD) define en el artículo 4.19 los datos biométricos como “datos personales obtenidos a partir de un tratamiento técnico específico, relativos a las características físicas, fisiológicas o conductuales de una persona física que permitan o confirmen la identificación única de dicha persona, como imágenes faciales o datos dactiloscópicos. Partiendo de esta definición, el artículo 9.1 incorpora como categoría especial los datos biométricos dirigidos a identificar de manera unívoca a una persona física”.

Para aclarar conceptos y concretar supuestos, la AEPD ha venido interpretando en diferentes informes (entre ellos, 2020/0036 y 2021/0047) y resoluciones de procedimientos sancionadores (como el PS 00218/2021), que los términos “permitan” y “confirmen” la identificación única de una persona física contenidos en la definición de datos biométricos del RGPD pueden entenderse, respectivamente, como “identificación” y “verificación” (o autenticación). Esta diferencia es la que precisamente le ha servido de base, hasta ahora, para interpretar cuándo un dato biométrico, según la definición del artículo 4.19 RGPD, se considera categoría especial de datos, conforme al artículo 9.1 RGPD.

Esta distinción entre identificación y verificación/autenticación biométrica ya se recogía en el Dictamen 3/2012 sobre la evolución de las tecnologías biométricas del Grupo del Artículo 29, que distinguía ambos supuestos en función del modo de búsqueda en los registros almacenados y el ingreso previo del registro.

Así, dicho Dictamen considera identificación biométrica el proceso de comparar los datos de un individuo, adquiridos en el momento de la identificación, con una serie de plantillas biométricas almacenadas en una base datos, dando lugar a un “proceso de búsqueda de correspondencias uno-a-varios”.

Por el contrario, se entiende por verificación/autenticación biométrica de un individuo el proceso de comparación entre sus datos biométricos, adquiridos en el momento de la verificación, con una única plantilla biométrica almacenada en un dispositivo. Es por tanto un “proceso de búsqueda de correspondencias uno-a-uno”.

Esta distinción se incorporó también en el Libro Blanco sobre Inteligencia Artificial de la Comisión Europea, de 19 de febrero de 2020, donde se distinguía entre identificación biométrica remota y autenticación biométrica. Esta última constituye “un procedimiento de seguridad basado en las características biológicas exclusivas de una persona que permite comprobar que es quien dice ser (comparación uno-a-uno)”, mientras que la identificación biométrica remota consiste en determinar la identidad de varias personas con ayuda de identificadores biométricos (huellas dactilares, imágenes faciales, iris, patrones vasculares, etc.) a distancia, en un espacio público y de manera continuada o sostenida, “comparándolos con datos almacenados en una base de datos”.

Sobre la base de esta distinción, la AEPD interpreta en el Informe 2020/0036 que el concepto de dato biométrico contenido en el artículo 4 del RGPD incluye tanto la identificación como la verificación/autenticación. Pero también señala en dicho informe que, con carácter general, “solo se consideran categoría especial de datos en los supuestos en que se sometan a tratamiento técnico dirigido a la identificación biométrica (uno-a-varios) y no en el caso de verificación/autenticación biométrica (uno-a-uno)”.

Esta misma interpretación lleva a la AEPD a afirmar en la resolución recaída en el PS 00218/2021 antes citado que la inclusión en el artículo 9.1 del RGPD los datos biométricos dirigidos a identificar de manera unívoca a una persona física como categoría especial de datos indica que “los datos biométricos, por naturaleza, no son sensibles, sino que dependerá del uso o contexto en que se utilicen, las técnicas empleadas para su tratamiento, y la consiguiente injerencia en el derecho a la protección de datos”.

Como no podía ser de otra manera, tratándose de una materia tan compleja como la protección de datos, la AEPD matiza su interpretación sobre la consideración de la categoría de los datos biométricos como datos sensibles, apelando a la necesaria valoración de las circunstancias de cada caso concreto y huyendo de conclusiones generales que permitan avalar su inclusión dentro de una u otra categoría. Y concluye que, en caso de duda, deberá adoptarse la interpretación más favorable para la protección de los derechos de los afectados “en tanto en cuanto no se pronuncie al respecto el Comité Europeo de Protección de Datos (CEPD) o los órganos jurisdiccionales”.

Este pronunciamiento ha sido recogido por el CEPD en las Directrices 5/2022 (Guidelines 05/2022 on the use of facial recognition technology in the area of law enforcement), que están pendientes de adopción definitiva, una vez finalizada su consulta pública el 27 de junio de 2022, y en las que, como es sabido, se aparta de la distinción entre identificación y verificación/autenticación a la hora de determinar si el tratamiento de datos biométricos es una categoría especial de datos. Concluye en el apartado 12 que ambos supuestos suponen un tratamiento de categorías especiales de datos.

¿Y cuál es la situación ahora?

Por un lado, el criterio mantenido hasta el momento por la AEPD ha permitido considerar, aun con carácter restrictivo y basado en el análisis de cada caso concreto, determinados tratamientos de datos biométricos como tratamientos no incluidos en las categorías especiales.

En este escenario, empresas desarrolladoras de aplicaciones y responsables del tratamiento han desarrollado e implementado soluciones y tratamientos que implican el uso de datos biométricos, tomando como base de legitimación alguna de las causas del artículo 6 del RGPD y sin tomar en consideración las excepciones y las medidas que el artículo 9 del RGPD establece para levantar la prohibición del tratamiento de categorías especiales de datos, por no considerarlo aplicable.

Por otro lado, nos encontramos con que la conclusión del CEPD recogida en las Directrices 5/2022 ya ha sido tomada en consideración por la AEPD en el Informe 2022/0098 al que hemos hecho referencia al inicio del artículo, donde advierte que “si dicho criterio se mantiene en el momento en que se proceda a su adopción definitiva, resultará necesario revisar nuestro criterio para adecuarlo al mantenido por el Comité Europeo de Protección de Datos, entendiendo que el tratamiento de datos biométricos, tanto en los supuestos de autenticación/verificación como de identificación implica un tratamiento de categorías especiales de datos, sometido al régimen de prohibición general y excepciones del artículo 9 del RGPD”.

Este aviso implica que, si finalmente el CEPD adopta las Directrices sin modificar su último criterio sobre la naturaleza de los datos biométricos (lo cual constituye una de las demandas de las entidades que han presentado comentarios en la fase de consulta pública), todo tratamiento que incluya este tipo de datos deberá no solo estar basado en, al menos, una de las causas de legitimación del artículo 6 del RGPD y en alguna de las excepciones previstas en el artículo 9, sino también haber realizado previamente una evaluación de impacto conforme al artículo 35 del RGPD, cuya ausencia en este tipo de tratamientos ya está siendo sancionada por la AEPD (PS 002108/2021, PS 00441/2021).

Por tanto, de confirmarse este criterio, cuando se pretenda, por ejemplo, basar la legitimidad del tratamiento de datos biométricos con fines de autenticación/verificación en el consentimiento del interesado o en el cumplimiento de una misión realizada en interés público conforme a los apartados a) y e) del artículo 6 RGPD, deberán concurrir además los requisitos del artículo 9.2.a) y g) que cualifican estas bases. Consecuentemente, el consentimiento deberá ser “explícito” y el interés público “esencial”, estar basado en el Derecho de la Unión o de los Estados miembros, ser proporcional al objetivo perseguido, respetar en lo esencial el derecho a la protección de datos y establecer medidas adecuadas y específicas para proteger los intereses y derechos fundamentales del interesado.

Adicionalmente, habrá que tener en cuenta las características y finalidad específica de cada tratamiento. Pensemos, por ejemplo, en un registro de jornada laboral basado en el uso de datos biométricos para autenticar a los empleados y respecto del que la AEPD ya ha considerado descartadas como aplicables las excepciones previstas en los apartados (b) [pues si bien el registro de jornada es obligatorio para el responsable del tratamiento, no resulta sin embargo obligatorio ni necesario a estos fines el tratamiento de datos biométricos] y (g) del artículo 9.2 RGPD [excepción que no será aplicable en tanto no medie una norma de rango legal que establezca el tratamiento de datos biométricos].

En este caso, únicamente cabrá considerar el consentimiento explícito del apartado 9.2.a) del RGPD, que, dada la propia naturaleza de la relación laboral y el desequilibrio inherente a la posición de las partes, solo podrá entenderse libremente prestado si el empleador ofrece al trabajador un sistema alternativo de registro que no implique el tratamiento de sus datos biométricos.

Así las cosas, y en espera de la adopción definitiva de las Directrices, se hace necesario empezar a revisar el estado actual de todos los tratamientos que incorporen este tipo de datos para adaptarlos a una previsible consideración de los mismos como tratamientos de categorías especiales de datos.

Coral Pelegrín Martínez-Canales

Equipo Govertis

KEEP READING

La Agencia Española de Protección de Datos (en adelante AEPD) elaboró una traducción de la “Guía básica de anonimización” elaborada por la Autoridad Nacional de Protección de Datos de Singapur (Personal Data Protection Commission – PDPC). Este documento nos proporciona orientaciones sobre cómo realizar de forma adecuada la anonimización básica y la desidentificación de conjuntos de datos estructurados, textuales y no complejos.

El Reglamento General de Protección de Datos (en adelante, “RGPD”) establece, en su art. 32, medidas para garantizar un nivel adecuado al riesgo; la seudonimización y el cifrado de datos personales. Es por ello que la anonimización y seudonimización permiten la protección de los datos personales de los interesados si se realiza de forma adecuada, siendo constitutiva de infracción muy grave “la reversión deliberada de un procedimiento de anonimización a fin de permitir la reidentificación de los afectados” (art. 72 Ley Orgánica 3/2018, de 5 de diciembre, de Protección de Datos Personales y garantía de los derechos digitales)

Para abordar el documento, es necesario partir de algunos conceptos básicos:

Los datos anonimizados no se consideran datos personales y, por lo tanto, no les resulta de aplicación la normativa de protección de datos. En este sentido se establece el Considerando 26 del RGPD.

En la Guía se presentan cinco pasos para anonimizar los conjuntos de datos cuando sea apropiado.

Un registro de datos personales se compone de atributos de datos que tienen diversos grados de identificabilidad y sensibilidad a un individuo. Por ejemplo: los “identificadores directos” son atributos que son exclusivos de un individuo y se pueden usar como atributos de datos clave para volver a identificar al individuo.

Para desidentificar los datos, es necesario eliminar todos los identificadores directos (por ejemplo, los nombres). Opcionalmente, se puede asignar un seudónimo a cada registro si es necesario vincular el registro a un individuo único.

En el siguiente paso, se aplicarán técnicas de anonimización de los identificadores indirectos para que no se puedan combinar fácilmente con otros conjuntos de datos que puedan contener información adicional para volver a identificar a las personas.

Al abordar el paso 4, en la Guía se menciona el método k-anonimidad para calcular el nivel de riesgo de reidentificación de un conjunto de datos.

El modelo k-anonimidad se utiliza como vía antes de que se hayan aplicado técnicas de anonimización (por ejemplo, generalización), y para la verificación posterior, para garantizar que los identificadores indirectos de cualquier registro sean compartidos por al menos k-1 otros registros. Por lo tanto, no es posible vincular o señalar el registro de un individuo, ya que siempre hay k atributos idénticos. La Guía añade la siguiente nota respecto a la k-anonimidad:

“Siempre que sea posible, debe establecer un valor de k-anonimidad más alto (por ejemplo, 5 o más) para el intercambio de datos externos, mientras que se puede establecer un valor más bajo (por ejemplo, 3) para el intercambio de datos internos o la retención de datos a largo plazo.

Sin embargo, si no puede anonimizar sus datos para lograrlo, debe implementar medidas de seguridad más estrictas para garantizar que los datos anonimizados no se divulguen a partes no autorizadas y se mitiguen los riesgos de reidentificación.

Alternativamente, puede contratar a expertos para que proporcionen métodos de evaluación alternativos para lograr riesgos de reidentificación equivalentes.”

Por último, la Guía cuenta con un Anexo donde se incluye un catálogo de técnicas básicas de anonimización de datos:

Igualmente, la AEPD en su web ofrece una herramienta gratuita de anonimización de datos para los usuarios en el siguiente enlace.

KEEP READINGEl pasado 23 de marzo, la Agencia Española de Protección de Datos (en adelante, AEPD) se pronunció sobre el registro de ciudadanos por parte de alojamientos turísticos, cuestión que ya había sido objeto de debate a raíz de la sanción económica impuesta a una empresa hotelera que solicitaba y escaneaba digitalmente, en el proceso de registro, los pasaportes de sus clientes, inclusive las fotografías de estos.

El supuesto de hecho descrito constituye un tratamiento de datos personales que requiere obligatoriamente, en virtud del principio de licitud que establece la normativa europea vigente (artículo 5.1 a del RGPD), de una base jurídica que lo legitime, no pudiendo el responsable del tratamiento (en este caso, el Hotel), realizar ninguna actividad de tratamiento sin estar habilitado a ello.

Entonces, ¿contaba la empresa reclamada con una base legitimadora que amparase la recogida de todos los datos personales que aparecen en el pasaporte del interesado? Pues bien, según las alegaciones planteadas, el Hotel defendía la licitud del tratamiento en el cumplimiento de lo dispuesto en la Ley de Protección de la Seguridad Ciudadana (LO 4/2015) que establece la obligación de contar con un registro documental en los establecimientos hoteleros, así como la comunicación de estos registros a las dependencias policiales – Fuerzas y Cuerpos de Seguridad del Estado (artículo 6.1 c del RGPD)-.

Si bien la obligación legal como base jurídica que legitima la recogida de los datos no parece plantear problema alguno, no parece ser así con el registro de las fotografías de los clientes. ¿Es el registro de estas imágenes estrictamente necesario para la correcta gestión hotelera y el cumplimiento de la obligación legal aplicable al responsable? Parece cuestionable.

En este punto, la empresa amparó el registro de dichas fotografías en la existencia de un interés legítimo para verificar la identidad de sus clientes en los consumos realizados durante su estancia, evitando así un uso fraudulento de la tarjeta por parte de terceros (artículo 6.1 f).

Recordemos que, en virtud de lo establecido en la normativa europea, solo cabrá valorar la aplicabilidad esta base de licitud del tratamiento cuando este se considere necesario para la satisfacción de intereses legítimos perseguidos por el responsable o por un tercero, siempre que sobre dichos intereses no prevalezcan los intereses o los derechos y libertades fundamentales del interesado que requieran la protección de datos personales.

Así, para invocar el interés legítimo como fundamento jurídico para el tratamiento de los datos personales, se necesitará realizar previamente, un triple juicio de ponderación que estudie la idoneidad, necesidad y proporcionalidad, en sentido estricto, del tratamiento analizado, así como interpretarlo de conformidad con el principio de minimización de los datos (artículo 5.1 c del RGPD). Dicho Juicio o prueba de ponderación entre el interés del responsable y los derechos del interesado no se llegó a justificar nunca por la empresa reclamada.

Sumado a esta falta de justificación de los intereses legítimos, que conlleva la desinformación del reclamante sobre la base legitimadora del tratamiento de sus datos, se constata que la cláusula informativa en materia de protección de datos facilitada a los clientes no incluía detalle alguno sobre la recogida y utilización de sus fotografías, ni figuraba dicho tratamiento en el Registro de Actividades de Tratamiento de la Entidad. Y, así mismo, no se llegó a aportar por parte de la empresa sancionada la información requerida en el procedimiento de instrucción: copia de la política de privacidad en todas sus versiones vigentes a partir de la entrada en vigor del Reglamento, así como cualquier aviso de privacidad y canal habilitado por la compañía para dar a conocer esta información a los interesados.

Por todo ello, y existiendo además medios menos invasivos para la consecución del fin alegado (verificar la identidad del usuario para evitar pagos fraudulentos) como, por ejemplo, solicitar al cliente su número de habitación, la recogida y utilización de la fotografía de los clientes por parte de la Entidad supone un tratamiento de datos personales excesivo que impide invocar el interés legítimo como base jurídica que lo legitime y que requiere, en consecuencia, de otra base legitimadora como es el consentimiento válido del interesado.

En definitiva, como futuros clientes de un alojamiento turístico, el Hotel solo podrá tratar aquella información personal contenida en su pasaporte amparándose en el cumplimiento de la obligación legal que le es aplicable, a excepción de su fotografía que no podrá ser registrada en los sistemas de información de la Entidad salvo que disponga de su consentimiento expreso.

Equipo Govertis

KEEP READING

El presente artículo pretende promover una reflexión sobre una de las cuestiones que surgen en la práctica con las Administraciones locales, y para ello recordar antes un par de conceptos.

El Padrón municipal es el registro administrativo donde constan los vecinos de un municipio. Sus datos constituyen prueba de la residencia en el municipio y del domicilio habitual. Las certificaciones que de dichos datos se expidan tienen carácter de documento público y fehaciente para todos los efectos administrativos. El padrón municipal, por una parte, está sujeto al ejercicio, por parte de los vecinos, de los derechos que otorga la legislación en protección de datos y, por otra parte, como información pública (en tanto obra en poder de la Administración) entra en el ámbito objetivo de la legislación de transparencia.

Como es sabido, al darnos de alta en el Padrón municipal, nuestros datos pasar a ser accesibles por el resto de las personas inscritas en la misma vivienda (mediante el certificado o volante colectivo). Si bien, puede darse el caso de que el propietario del inmueble no esté empadronado en el mismo. Entonces, ¿podría acceder a los datos de las personas empadronadas en su propiedad?

Durante la época en la que regía la LOPD, se ha establecido una suerte de consenso –lamentablemente indiscutido– sobre que la condición de propietario, sin que concurra la circunstancia de estar empadronado en la vivienda, no otorga ningún derecho a consultar quién está empadronado en la finca de la que es titular.

Uno de los comentarios más difundidos al respecto corresponde a la edición El Consultor de los Ayuntamientos (núm. 4, Editorial La Ley, 14 de marzo de 2013) y reza así: “está claro que deben denegar la petición del propietario del inmueble, pues la información solicitada de los datos del padrón afecta a la intimidad de las personas que viven en el inmueble”.

Esta postura surgió de traer a colación el que “el domicilio [¿el domicilio?] es una de las facetas más singularmente reservadas de la vida de la persona”, enfocando así los derechos fundamentales a la intimidad y a la privacidad. La norma sectorial de referencia es el art. 53.3 del Real Decreto 1690/1986 (Reglamento de Población y Demarcación Territorial de las Entidades Locales) que dispone que los datos del padrón son confidenciales y el acceso a los mismos se regirá por lo dispuesto en la LOPD, la cual, a su vez, establecía que solo podrán ser comunicados a un tercero con el previo consentimiento de los afectados; es decir, de todos los inscritos en la vivienda.

Considerar al propietario del inmueble como “tercero”, por el mero hecho de no estar empadronado en la vivienda, es lo que debía de haber generado ya entonces algún tipo de contestación, toda vez que uno de los presupuestos para cursar alta en el Padrón es que el futuro vecino aporte la autorización de ese mismo propietario. El trasfondo problemático del asunto es que, una vez empadronado, el vecino puede autorizar según le plazca nuevas altas en la vivienda sin conocimiento del propietario.

Hoy en día, con la entrada en vigor del RGPD, la expedición de certificaciones y/o volantes sobre de la totalidad de las personas inscritas en un mismo domicilio, deberá estar fundamentada en alguno de los supuestos del artículo 6.1 del RGPD.

La AEPD, respondiendo a una pregunta frecuente sobre esto mismo (“¿Se puede comunicar información sobre la inscripción padronal de todas las personas inscritas en un inmueble al propietario del mismo?”) en su guía sectorial Protección de datos y Administración local (2019), limita –de manera aparentemente errónea– la posible legitimación a un único supuesto cuando dice así:

“La comunicación de datos del Padrón municipal queda limitada por el citado artículo 16.3 de la LBRL a las Administraciones públicas, por lo que atendiendo al principio de legitimación de datos del artículo 6 del RGPD, y puesto que el solicitante no ostenta tal condición, únicamente cabrá el consentimiento del afectado para el acceso a los datos del padrón en el supuesto de hecho planteado.”

Afortunadamente, el debate sigue abierto gracias a que la Autoridad Catalana de Protección de Datos emitió en 2018 su “Dictamen sobre la consulta formulada por el Delegado de protección de datos de un ayuntamiento en relación con una solicitud de un certificado de convivencia histórico de una vivienda presentada por un propietario no empadronado” (CNS 38/2018).

En ese caso concreto, el solicitante interesaba un certificado de convivencia histórico de una vivienda de la que es propietario, pero en la que nunca ha estado empadronado, para un procedimiento de desahucio. La opinión emitida por la APDCAT concluye lo siguiente:

“La normativa de protección de datos no impediría el acceso a los datos del padrón relativos a la convivencia histórica en un domicilio a petición del propietario del mismo emparado en la Ley 19/2014, de 29 de diciembre, de transparencia, acceso a la información pública y buen gobierno, siempre y cuando, una vez ponderados los derechos en juego, concurra un interés directo en el solicitante de la información y esta comunicación de información no suponga un prejuicio significativo para el derecho a la protección de datos de las personas afectadas.”

Lo que ocurre es que este dictamen suscita cuestiones adicionales.

Por un lado, opta por salir del ámbito del RGPD, cuando este permite la posibilidad de argumentar una base de legitimación distinta al consentimiento, del art. 6.1: “f) el tratamiento es necesario para la satisfacción de intereses legítimos perseguidos por el responsable del tratamiento o por un tercero, siempre que sobre dichos intereses no prevalezcan los intereses o los derechos y libertades fundamentales del interesado que requieran la protección de datos personales, en particular cuando el interesado sea un niño”.

Por otro lado, además del juicio de ponderación, en este dictamen se advierte, en relación con la afectación de derechos o intereses de terceros, “la importancia de que el ayuntamiento dé traslado de la solicitud a estas personas afectadas (la persona o personas que estarían empadronadas en el domicilio), tal y como prevén los artículos 31.1 y 42 de la LTC, de modo que se pueda saber si concurre alguna circunstancia personal concreta que justifique la limitación del derecho de acceso”. Esta salvaguarda, en la práctica, podría perjudicar los intereses legítimos invocados, cuando menos por los tiempos, y en todo caso no se entiende si partimos del presupuesto lógico de que el propietario de una vivienda debería tener derecho a saber quien está inscrito en la misma.

En lo que no cabe duda del dictamen es que, para el caso de menores empadronados, “habría que valorar la posibilidad de no incluir sus datos personales en la comunicación de la información correspondiente ya que estos no parecen necesarios para lograr la finalidad del acceso”, sugiriendo incluir solo el número de menores empadronados y sus edades. Pero esto, una vez más, nos devuelve al art. 6.1.f) del RGPD.

Mientras tanto, como también señala el citado dictamen, la Ley de Bases del Régimen Local y el consecuente régimen específico de acceso a los datos del padrón municipal de habitantes no prevé, con carácter general, el acceso de los particulares no empadronados a los datos padronales de otras personas.

Andreu Yakubuv-Trembach

Equipo Govertis

La Agencia Española de Protección de Datos ha publicado la nueva Guía para la gestión del riesgo y evaluación de impacto en tratamiento de datos personales, cuyo objetivo es actualizar conforme a nuevos los nuevos criterios e interpretaciones de la AEPD, el Comité europeo de Protección de Datos y el Supervisor Europeo de Protección de Datos y unificar las guías “Guía práctica de análisis de riesgo para el tratamiento de datos personales” y la “Guía práctica para la evaluación de impacto en la protección de datos personales” publicadas por la AEPD hace tres años.

Esta Guía comienza explicando el concepto de riesgo, primero de forma genérica y luego focalizada en la protección de los datos personales, indicando que el RGPD da total libertad para la gestión del riesgo, ya que debe integrarse con el resto de los recursos de la organización de gestión de riesgos, políticas y gobernanza.

Se especifica que la gestión del riesgo no puede, en ningún caso, sustituirse por el cumplimento normativo, o por una póliza de seguros que cubra la responsabilidad de la organización en caso de que haya una infracción de la normativa de protección de datos, sino que, ante cualquier tratamiento, la organización tiene adoptar medidas técnicas y organizativas que protejan los derechos y libertades de las personas, tanto a nivel individual como social y aunque el riesgo sea escaso. Por ello esta Guía indica que “Si una entidad pretende abordar un tratamiento y no tiene la capacidad para hacer la necesaria la gestión del riesgo, estará obligada a buscar algún tipo de ayuda, como recurrir a la consultoría externa, para realizarlo de la forma apropiada”, ya que el objetivo no es sólo poder actuar ante un hecho que ocasione un perjuicio para los derechos y libertades del interesado, sino haber implementado las medidas adecuadas para poder prevenirlo. En Govertis podemos ayudarte con el cumplimiento de todas las obligaciones de la normativa de protección de datos.

La Guía analiza las fases que debe tener un proceso de gestión del riesgo, haciendo hincapié en la importancia de detallar el tratamiento que se quiere llevar a cabo, describiendo su propósito, su naturaleza, su alcance y su contexto.

Una nueva referencia que se hace en esta Guía, y que no se hacía en las anteriores de forma expresa, es la importancia que tiene la gestión de la seguridad de la información. En concreto se indica que la implementación en la organización de modelos de gestión, como el Sistema de Gestión de la Seguridad de la Información (SGSI) y de directrices como las normas ISO 27000 o el Esquema Nacional de Seguridad, además de políticas de información de la entidad y las políticas de seguridad, son medios para poder gestionar los riesgos de forma efectiva y eficaz y, de esta forma, poder considerar que los sistemas de información de la entidad cumplen con unos mínimos de seguridad que exigen estos modelos, directrices, estándares y políticas. Pero no es suficiente con esto, sino que las medidas de seguridad que se implementen en la organización tienen que revisarse continuamente dado que la actividad de tratamiento, y por ende el riesgo, puede evolucionar por diversos factores como un cambio en el contexto, factores externos, nuevas necesidades, la modificación de los medios tecnológicos utilizados etc.

Otro punto importante que aparece en esta nueva Guía, es el concepto de la “Gobernanza de los riesgos para los derechos y libertades” relacionado con el cumplimiento del principio de responsabilidad proactiva en el que la organización debe implementar políticas de protección de datos que se apliquen de una forma efectiva, práctica y ejecutiva en toda la organización y no se reduzcan a una mera declaración de voluntad de compromiso. Estos documentos relativos a la gestión del riesgo han de estar documentados y deberán contener unos elementos mínimos descritos en la Guía.

En el segundo capítulo se expone una metodología, en concreto unos mínimos, para la descripción del tratamiento, ya esto se considera el punto más importante para poder gestionar los riesgos de forma eficaz. Se propone realizar el estudio del tratamiento para realizar la gestión del riesgo sobre el mismo, hasta en tres niveles de detalle:

Además, se introducen dos nuevos conceptos para el cálculo del nivel del riesgo cuando hay dos o más factores de riesgo que apunten a un determinado nivel de impacto, y cuando haya dos o más indicios que apunten a un determinado nivel de probabilidad: el coeficiente de impacto acumulado y el coeficiente de probabilidad acumulado.

Al igual que la Guía de Evaluaciones de Impacto, la Guía expone una tabla de ejemplos de controles para afrontar los riesgos. Estos controles resultan muy útiles a la hora de determinar qué controles son los más adecuados en nuestro tratamiento.

La tercera sección se reserva para explicar la Evaluación de Impacto: quien la realiza, en qué momento y las excepciones a su realización por no ser legalmente necesario, así como la excepción a su realización antes del inicio de las actividades de tratamiento, por ser necesaria la revisión y adaptación en el ciclo de vida de este. Centrándonos en esta última excepción, la pregunta lógica es: si antes de la entrada en aplicación del RGPD no tenía la obligación de hacer una Evaluación de Impacto sobre un tratamiento que ya venía realizando, ¿lo tengo que hacer ahora? La propia Guía contesta a esto afirmando que, como parte de las obligaciones de responsabilidad proactiva del responsable del tratamiento, es necesario que se realice esta Evaluación de Impacto si fuera necesaria.

Además, se desarrolla la exigencia relativa a la evaluación de la necesidad y proporcionalidad del tratamiento, haciendo una ponderación del juicio de proporcionalidad, del juicio de necesidad y del juicio de proporcionalidad en sentido estricto. Es importante tener en cuenta que el hecho de realizar esta evaluación no sustituye a la realización de la Evaluación de Impacto, ya que el objetivo de ambas es diferente. Lo que si es cierto es que, si no se puede demostrar la necesidad y la proporcionalidad de un tratamiento de alto riesgo, no se recomienda continuar con la Evaluación de Impacto o plantear una consulta previa del artículo 36 RGPD.

Un apunte que realiza la Guía, es que en los casos en los que se realice un análisis de necesidad, y la justificación se base en la exigencia de responder a una situación concreta de urgencia, el responsable tiene que vigilar que esta situación concreta de urgencia sigue estando vigente, ya que, en caso contrario, no estaría justificado seguir realizando este tratamiento.

Por último, se aborda la cuestión de las consultas previas a la AEPD cuando, tras haber realizado una EIPD, el riesgo residual resultante podría poner en riesgo los derechos y libertades de los interesados.

Como se puede observar, la AEPD ha querido compilar toda la información relativa a la gestión de los riesgos y las Evaluaciones de Impacto en una completa Guía.

Si quieres aprender más sobre la gestión de los riesgos y la evaluación de impacto, o en refrendar tus habilidades, la AEC ofrece el siguiente curso de especialización para que puedas fortalecer tus conocimientos, Taller práctico de análisis de riesgos y evaluaciones de impacto en protección de datos.

Ana Vicente Cuesta

Equipo Govertis.